Codice di Condotta AI Generativa – La guida volontaria

Codice di Condotta sull’IA Generativa

La nuova guida volontaria per Data Controller e Data Processor in vista dell’AI Act

L’Europa compie un passo importante nella regolamentazione dell’intelligenza artificiale presentando ufficialmente il Codice di Condotta per l’IA Generativa (General-Purpose AI Code of Practice). Si tratta di uno strumento volontario, pensato per preparare aziende, sviluppatori e operatori del trattamento dati al percorso di adeguamento all’AI Act, la prima legge al mondo a disciplinare l’IA in base al principio del rischio.

Un codice volontario ma strategico

Il Codice nasce per offrire un quadro di riferimento anticipato a chi sviluppa o integra sistemi di intelligenza artificiale generativa, con l’obiettivo di facilitare la compliance futura e ridurre gli impatti organizzativi, tecnici e legali previsti dal nuovo Regolamento europeo. Sebbene la sua adozione non sia obbligatoria, rappresenta una best practice per chi intende dimostrare accountability, trasparenza e responsabilità nel trattamento dei dati all’interno di sistemi IA ad ampia applicazione.

Il codice si concentra sui modelli di IA general-purpose (GPAI): modelli base altamente versatili, utilizzabili per generare testi, immagini, codice, decisioni automatizzate. Tra questi rientrano noti sistemi come GPT, Claude, LLaMA, tecnologie sempre più centrali nella digitalizzazione delle imprese.

L’AI Act entrerà in vigore ad agosto 2024, ma diventerà pienamente applicabile dal 2026 per i nuovi modelli e dal 2027 per quelli già presenti sul mercato. Il Codice, pubblicato dalla Commissione Europea con il contributo di oltre 1.000 stakeholder, vuole essere un ponte tra la situazione attuale e la piena applicazione della normativa.

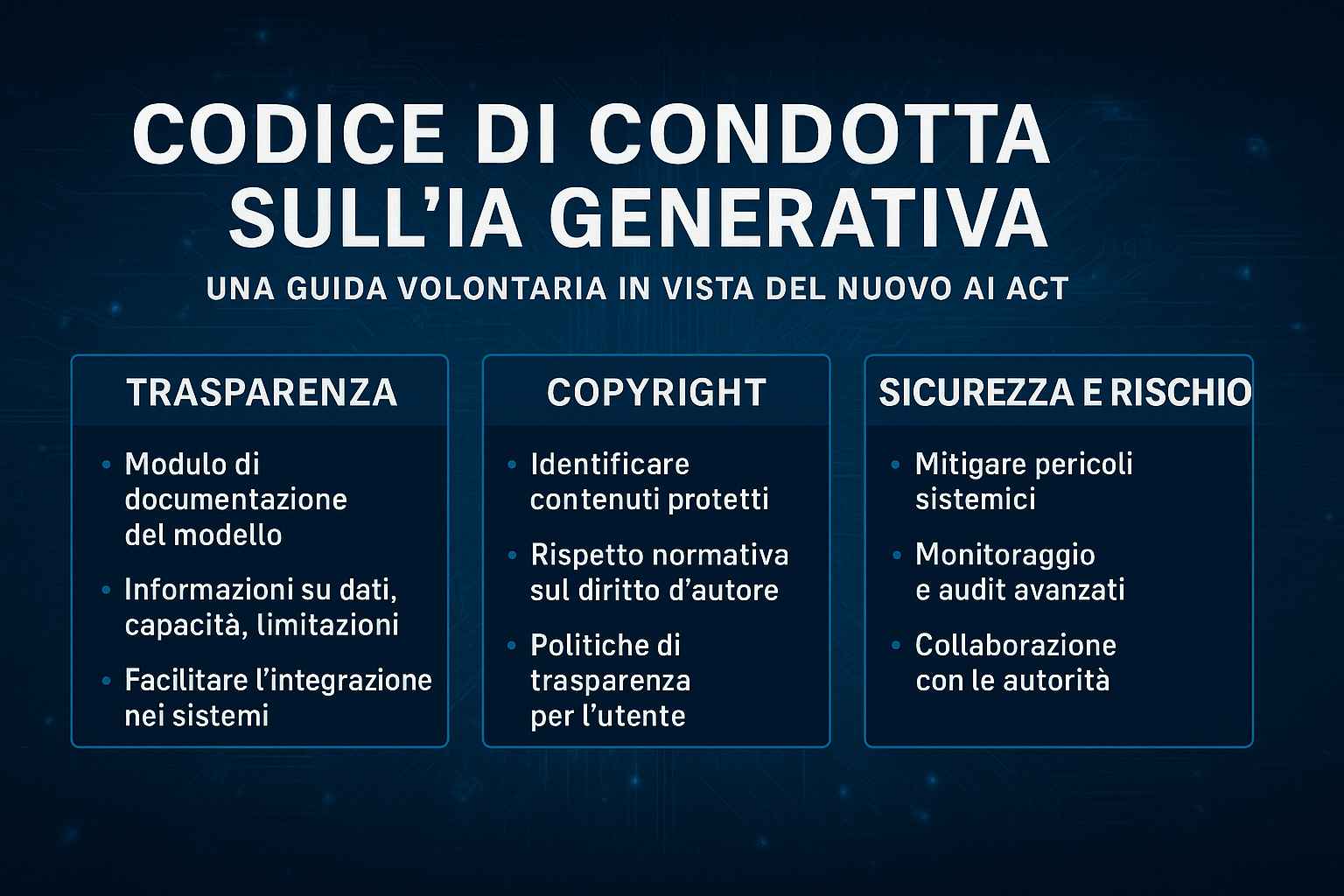

I tre pilastri del Codice: trasparenza, copyright, sicurezza

Il documento, articolato in tre capitoli principali, offre indicazioni concrete sulle aree chiave di responsabilità, con implicazioni operative dirette per Data Controller, Data Processor, sviluppatori e integratori IA.

-

Trasparenza: la documentazione del modello

Uno dei cardini del Codice è la trasparenza nella progettazione e nell’uso dei modelli IA. Viene introdotto il Model Documentation Form, un modulo standardizzato per descrivere:

- i dati utilizzati per l’addestramento;

- le capacità funzionali del modello;

- le limitazioni tecniche e semantiche;

- gli impieghi previsti e quelli vietati.

Questo documento non solo aiuta i provider a comprendere e controllare meglio i loro modelli, ma rappresenta una base utile per l’integrazione nei servizi digitali, dove il trattamento dei dati deve essere trasparente, tracciabile e conforme al GDPR.

Per le aziende, questo significa disporre di informazioni essenziali per la valutazione del rischio e per eventuali DPIA (Data Protection Impact Assessment), ove richiesto.

-

Copyright: la sfida dei contenuti protetti

Il secondo capitolo del Codice affronta uno dei temi più critici: il rispetto della normativa europea sul diritto d’autore. L’uso di materiali protetti nei dataset di addestramento rappresenta infatti un punto di rischio sia giuridico che reputazionale.

Il Codice invita i fornitori di modelli e i Data Controller a:

- dotarsi di procedure di identificazione dei contenuti coperti da copyright;

- implementare policy attive per il rispetto dei diritti di terzi;

- predisporre meccanismi di trasparenza per l’utente finale sull’origine dei dati e sull’uso di output generati da IA.

Per i Responsabili del trattamento, questo implica l’obbligo di controllare la liceità dei dati usati per l’addestramento, e di garantire che gli output dell’IA non violino diritti di proprietà intellettuale.

-

Sicurezza e rischio sistemico: modelli ad alto impatto

Il terzo ambito è riservato ai modelli più avanzati, considerati a rischio sistemico. Si fa riferimento a scenari estremi: uso di IA per la creazione di armi chimiche o biologiche, manipolazione cognitiva o perdita di controllo del sistema.

Il Codice propone in questo caso misure di frontiera per la mitigazione del rischio, tra cui:

- monitoraggio continuo delle capacità emergenti;

- audit indipendenti;

- sistemi di interruzione (kill switch);

- collaborazione strutturata con autorità di regolazione e sicurezza.

Anche in questo contesto, Data Controller e Processor devono valutare se i sistemi utilizzati ricadano in categorie ad alto impatto, per poi implementare politiche proporzionali.

AI Act e Codice: cosa devono fare le imprese

Per le aziende europee – e anche per quelle extra-UE che offrono servizi nell’Unione – il Codice rappresenta una guida operativa per iniziare a costruire il proprio sistema di governance IA.

Ecco le azioni consigliate per imprese, enti pubblici e professionisti che operano con sistemi di IA generativa:

- Mappare i modelli IA utilizzati in azienda, distinguendo tra strumenti interni e tecnologie fornite da terze parti.

- Valutare l’impatto sui trattamenti di dati personali, predisponendo eventuali DPIA.

- Verificare la documentazione disponibile sui modelli (Model Card, schede tecniche) per valutare trasparenza e conformità.

- Aggiornare le informative privacy per includere l’uso di IA generativa e i possibili automatismi decisionali.

- Formare il personale su rischi e opportunità legati all’uso dell’IA.

- Integrare i principi del Codice nelle policy aziendali, anche in ottica ESG e responsabilità sociale.

Conclusioni

Il Codice di Condotta sull’IA Generativa non è una norma vincolante, ma un’anticipazione intelligente delle misure che presto saranno obbligatorie con l’entrata in vigore dell’AI Act. Per i Data Controller e i Data Processor rappresenta un’occasione per anticipare gli adempimenti, migliorare la compliance e prepararsi a un mercato regolato e trasparente.

Aderire oggi al Codice significa mostrare impegno, responsabilità e consapevolezza, valori ormai imprescindibili in un contesto digitale che cambia rapidamente, ma che deve rimanere ancorato ai diritti e alle libertà fondamentali delle persone.