AI ACT E AI LITERACY: COSA CAMBIA PER LE IMPRESE

A partire da febbraio è entrato progressivamente in vigore il nuovo AI Act, il primo regolamento europeo sull’intelligenza artificiale. L’obiettivo dell’Unione Europea è chiaro: garantire che l’uso dell’intelligenza artificiale sia sicuro, etico e trasparente, a tutela dei cittadini e del mercato interno.

Una delle novità più rilevanti per le imprese riguarda l’adempimento di informare il personale, sia nei casi in cui l’azienda sviluppi, sia nei casi in cui utilizzi sistemi di intelligenza artificiale.

Questo obbligo è indicato come requisito di AI literacy

(alfabetizzazione in materia di IA)

e costituisce un nuovo tassello nelle strategie di compliance.

Vediamo cosa prevede la norma, chi coinvolge e quali sono gli adempimenti più urgenti.

- AI ACT: UNA PANORAMICA

1.1 La carta d’identità della legge

L’AI Act è un regolamento europeo, approvato in via definitiva nel 2024, pensato per regolamentare lo sviluppo, l’immissione sul mercato e l’utilizzo di sistemi di intelligenza artificiale all’interno dell’Unione Europea. Trattandosi di un regolamento, è direttamente applicabile in tutti gli Stati membri, senza necessità di recepimento nazionale.

Il principio guida del regolamento è la classificazione dei sistemi di IA in base al rischio che comportano per i diritti fondamentali delle persone:

- Rischio inaccettabile: sistemi vietati (es. social scoring in stile cinese);

- Alto rischio: soggetti a obblighi rigorosi di sicurezza, documentazione, trasparenza e governance;

- Rischio limitato: soggetti a obblighi informativi;

- Rischio minimo: uso libero, ma con raccomandazioni etiche.

1.2 A chi si applica l’AI Act?

L’AI Act si applica a tutti i fornitori, importatori, distributori, operatori e utilizzatori di sistemi di IA che operano nel mercato europeo, indipendentemente dalla localizzazione geografica. Questo significa che anche aziende extra-UE sono tenute a rispettare il regolamento se offrono servizi o prodotti in Europa.

Tra i soggetti coinvolti rientrano anche:

- Imprese che integrano sistemi di IA nei propri processi;

- Aziende che acquistano soluzioni IA da terzi;

- Fornitori di chatbot, sistemi di selezione automatica, scoring, diagnosi medica assistita da IA, ecc.

1.3 Obblighi, requisiti, sanzioni

Per i sistemi ad alto rischio, sono previsti numerosi obblighi documentali e procedurali tra cui:

- Valutazione del rischio prima della messa in servizio;

- Supervisione umana;

- Tracciabilità dei dati e del modello;

- Registrazione nel database europeo dei sistemi IA;

- Conformità alla normativa privacy (GDPR);

- Obbligo di formazione (AI literacy) per operatori e utenti.

Le sanzioni possono arrivare fino a 35 milioni di euro o al 7% del fatturato globale annuo, a seconda della gravità dell’infrazione.

- COME IMPATTERÀ SUL SISTEMA IMPRESA: GLI STEP PER ADEGUARSI

2.1 Che cosa si intende per AI literacy?

Con il termine AI literacy si intende il livello minimo di conoscenze, competenze e consapevolezze che dipendenti, collaboratori e operatori devono possedere quando interagiscono con un sistema di intelligenza artificiale. Non è sufficiente sapere che cosa fa l’IA: occorre anche comprendere come funziona, quali limiti ha, quali rischi genera e come gestirla in modo responsabile.

L’AI literacy è essenziale per:

- Riconoscere bias algoritmici e prevenire discriminazioni;

- Comprendere il ruolo dell’operatore umano;

- Comprendere i principi etici e le normative applicabili;

- Poter intervenire correttamente in caso di malfunzionamenti o violazioni;

- Rafforzare la fiducia dell’utente nei confronti delle tecnologie IA.

2.2 I contenuti dell’adempimento formativo

L’AI Act non definisce ancora uno standard univoco per i programmi formativi, ma stabilisce che devono essere adeguati al ruolo ricoperto, documentabili e aggiornati.

I percorsi di formazione potranno includere:

- Definizione di IA e classificazione dei rischi;

- Funzionamento e limiti dei sistemi algoritmici;

- Aspetti etici e normativi (AI Act, GDPR, Codici etici);

- Casi pratici e simulazioni con attenzione alle criticità;

- Gestione delle segnalazioni e dei reclami;

- Ruolo umano nella supervisione delle decisioni automatizzate.

Teoricamente la formazione va erogata prima dell’utilizzo dei sistemi IA e possibilmente ripetuta periodicamente, con evidenza della partecipazione.

2.3 Strategie di compliance

Per le imprese, questo adempimento impone un ripensamento organizzativo. Le azioni da intraprendere includono:

- Mappatura dei sistemi di IA già utilizzati o in fase di adozione;

- Classificazione del rischio (alto, limitato, minimo) secondo i criteri dell’AI Act;

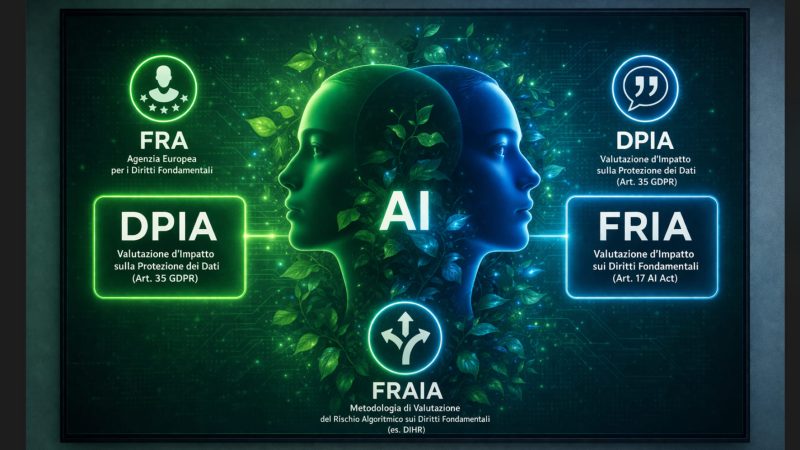

- Aggiornamento delle informative privacy e dei DPIA (Data Protection Impact Assessment);

- Redazione o aggiornamento del registro dei trattamenti IA;

- Designazione dei referenti IA aziendali, in coordinamento con DPO, IT manager, compliance officer;

- Piano formativo per dipendenti e collaboratori sull’uso etico e consapevole dell’IA;

- Contrattualizzazione dei fornitori IA, con obblighi specifici in tema di trasparenza e sicurezza.

CONCLUSIONI: UN’OPPORTUNITÀ PER IL SISTEMA IMPRESA

L’introduzione dell’AI Act non è solo un obbligo normativo, ma rappresenta anche un’opportunità di crescita per le aziende europee. Chi saprà strutturare per tempo una governance efficace dell’intelligenza artificiale potrà:

- Rafforzare la reputazione aziendale in termini di trasparenza e affidabilità;

- Ridurre i rischi legali e operativi;

- Sfruttare l’IA per innovare in sicurezza;

- Migliorare la preparazione del personale nei confronti delle tecnologie emergenti;

- Accedere più facilmente a partnership, bandi, gare e fondi europei.

Il 2025 è l’anno della svolta: l’AI literacy entra ufficialmente nella compliance e diventa una leva competitiva. Per le imprese è il momento di agire, dotandosi di piani di formazione, sistemi di monitoraggio e policy aggiornate.