Artificial Intelligence e Diritto: le nuove sfide tra gdpr e ai act

L’integrazione dell’Intelligenza Artificiale (IA) nelle attività aziendali sta determinando un cambiamento epocale. Tuttavia, questo progresso porta con sé interrogativi complessi in materia giuridica, soprattutto riguardo la tutela della privacy e dei dati personali. Nell’Unione Europea il quadro normativo di riferimento si fonda oggi su due pilastri: da un lato il Regolamento Generale sulla Protezione dei Dati (GDPR – Reg. UE 2016/679), dall’altro il più recente Artificial Intelligence Act (AI Act – Reg. UE 2024/1689), prima legge al mondo dedicata specificamente alla regolamentazione dell’IA.

Per le imprese ciò significa dover trovare un equilibrio tra innovazione, competitività e salvaguardia dei diritti fondamentali degli individui.

I PRINCIPI DEL GDPR NELL’ERA DELL’IA

Il GDPR rimane il punto di riferimento centrale per tutto ciò che riguarda la protezione dei dati personali. L’adozione di sistemi di IA non può prescindere dal rispetto dei principi cardine del Regolamento:

- Trasparenza e informazione: gli articoli 13 e 14 GDPR stabiliscono l’obbligo di informare chiaramente gli interessati circa l’uso di strumenti di IA, spiegando la logica delle decisioni automatizzate e le possibili conseguenze. L’art. 22 vieta decisioni basate esclusivamente su trattamenti automatizzati, se queste producono effetti giuridici o incidono in maniera significativa sull’individuo.

- Minimizzazione dei dati: ai sensi dell’art. 5, par. 1, lett. c GDPR, le aziende devono raccogliere e trattare solo i dati realmente necessari. I modelli di IA devono quindi essere progettati per evitare raccolte ridondanti o sproporzionate.

- Revisione umana: sempre l’art. 22 riconosce il diritto della persona a chiedere l’intervento umano per contestare decisioni prese unicamente da algoritmi, garantendo così un controllo effettivo sui processi automatizzati.

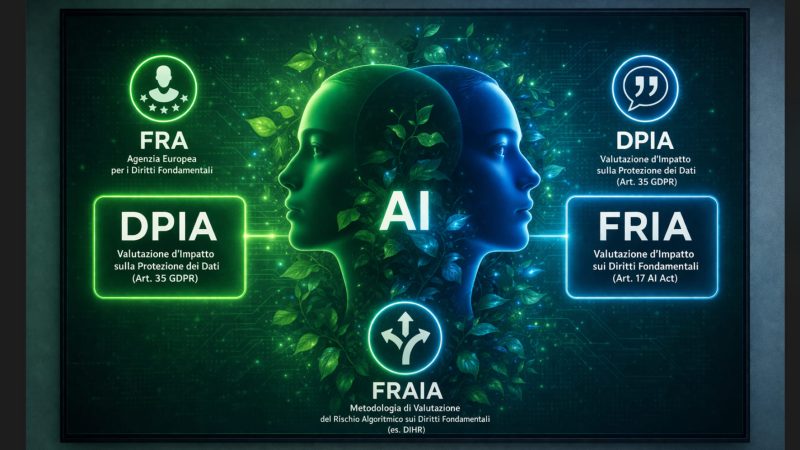

- Valutazione d’impatto (DPIA): l’art. 35 obbliga a svolgere una DPIA quando il trattamento comporta rischi elevati. Questo è spesso il caso dei sistemi IA ad alto impatto, dove occorre analizzare natura, finalità e contesto del trattamento, prevedendo contromisure concrete.

- Base giuridica del trattamento: ogni utilizzo di dati personali in ambito IA deve poggiare su una base legale valida (art. 6 GDPR). Quando sono coinvolte decisioni automatizzate, la base deve essere particolarmente solida, ad esempio consenso esplicito o legittimo interesse chiaramente motivato.

L’AI ACT: NUOVI STANDARD E RESPONSABILITÀ

Accanto al GDPR, l’AI Act introduce regole specifiche per progettazione, immissione sul mercato e utilizzo dei sistemi di IA. L’obiettivo principale è garantire che tali strumenti siano sicuri, affidabili ed etici.

- Classificazione per livelli di rischio: l’AI Act distingue i sistemi a rischio inaccettabile (vietati, come la sorveglianza di massa o il social scoring), quelli ad alto rischio (sottoposti a requisiti molto severi, ad esempio in ambito sanitario, trasporti o HR) e quelli a rischio limitato o minimo (con obblighi più lievi).

- Doveri di fornitori e utilizzatori: chi sviluppa o impiega un sistema di IA deve adottare procedure di gestione della qualità, misure di trasparenza algoritmica, valutazioni e mitigazioni dei rischi, oltre a garantire un monitoraggio costante anche dopo la messa in commercio.

- Regime sanzionatorio: le sanzioni sono proporzionate alla gravità e vanno fino a 35 milioni di euro o il 7% del fatturato globale annuo, confermando l’approccio rigoroso dell’UE nella gestione delle tecnologie emergenti.

I RISCHI SPECIFICI DELL’IA

Integrare l’intelligenza artificiale nei processi aziendali significa affrontare nuovi rischi che richiedono strategie dedicate di mitigazione:

- Fughe o perdite di dati: affidarsi a piattaforme non controllate può esporre a fuoriuscite di informazioni sensibili. Servono crittografia, anonimizzazione e accessi regolamentati.

- Bias algoritmici: se i dati di addestramento contengono pregiudizi, l’IA rischia di amplificarli producendo risultati discriminatori. È fondamentale implementare controlli umani e revisioni periodiche della qualità dei dataset.

- Addestramento non autorizzato: i modelli di IA generativa potrebbero riutilizzare contenuti protetti o riservati. Senza adeguate misure di protezione, l’impresa può violare diritti d’autore o rivelare segreti commerciali.

- Impatto sui diritti fondamentali: l’uso in settori sensibili (salute, lavoro, istruzione) comporta il rischio di decisioni che incidono profondamente sulla vita delle persone, richiedendo basi giuridiche solide e trasparenza totale.

COME DEVONO MUOVERSI LE AZIENDE ITALIANE

Per non farsi trovare impreparate, le imprese dovrebbero:

- Aggiornare le informative privacy e i registri dei trattamenti, includendo espressamente l’uso dell’IA.

- Garantire la trasparenza sui meccanismi di funzionamento degli algoritmi e sugli scopi per cui vengono utilizzati.

- Implementare misure di sicurezza robuste (crittografia, pseudonimizzazione, controlli di accesso).

- Condurre DPIA regolari sui sistemi ad alto rischio.

- Assicurare sempre la possibilità di intervento umano nelle decisioni automatizzate.

- Valutare e ridurre i rischi in linea con i criteri imposti dall’AI Act.

Conclusioni

Il binomio GDPR + AI Act rappresenta un quadro normativo complesso ma imprescindibile. Da un lato il GDPR tutela i dati personali con principi universali e consolidati, dall’altro l’AI Act introduce regole ad hoc per assicurare che lo sviluppo dell’IA sia sicuro, etico e sotto controllo.

Per le aziende italiane ed europee, la sfida è duplice: cogliere le opportunità dell’IA senza rinunciare alla conformità normativa e alla protezione dei diritti fondamentali. Solo con un approccio basato su trasparenza, accountability e formazione del personale (AI literacy) sarà possibile conciliare innovazione e responsabilità, trasformando l’IA in un alleato competitivo e non in una fonte di rischio giuridico.