FRIA e AI Act: dalla compliance formale alla responsabilità sostanziale

Con l’entrata in vigore progressiva dell’AI Act, uno degli elementi destinati a incidere maggiormente sull’organizzazione delle imprese e delle pubbliche amministrazioni è la Valutazione d’Impatto sui Diritti Fondamentali (FRIA). A differenza di altri strumenti già noti nel panorama della compliance, la FRIA non si limita a introdurre un ulteriore adempimento documentale, ma impone un cambio di paradigma: dal controllo dei dati alla valutazione degli effetti sistemici delle tecnologie.

Il punto di partenza è chiaro. L’Unione Europea ha scelto un approccio basato sul rischio, classificando i sistemi di intelligenza artificiale in funzione del loro impatto potenziale. Per i sistemi ad alto rischio, non è più sufficiente dimostrare la conformità tecnica o la sicurezza del trattamento dei dati. Diventa necessario interrogarsi su come tali sistemi influenzino diritti più ampi, come la non discriminazione, l’equità, la dignità umana e l’accesso a opportunità e servizi.

In questo contesto, la FRIA si colloca come uno strumento preventivo e decisionale. Non si tratta di un controllo ex post, ma di una valutazione che deve avvenire prima dell’implementazione operativa del sistema. Questo elemento temporale è cruciale e spesso sottovalutato: significa che le organizzazioni devono integrare la valutazione dei rischi nei processi di progettazione e non limitarla a una verifica finale.

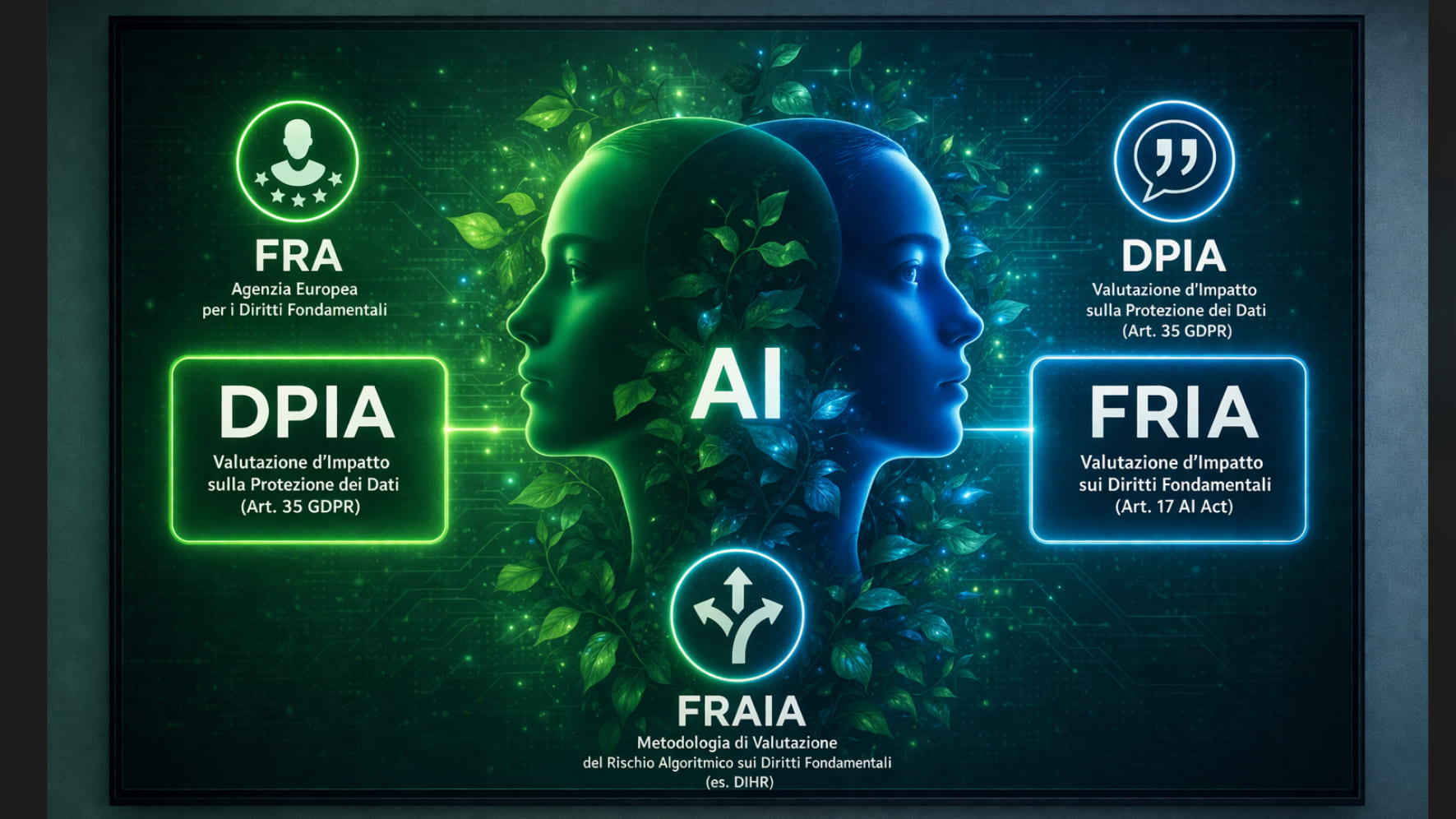

Un errore diffuso è considerare la FRIA come una semplice estensione della DPIA prevista dal GDPR. In realtà, questa lettura rischia di ridurre drasticamente la portata dello strumento. La DPIA, ai sensi dell’articolo 35 del GDPR, è centrata sulla protezione dei dati personali, mentre la FRIA, ai sensi dell’articolo 17 dell’AI ACT, amplia il perimetro di analisi includendo impatti sociali, economici e persino etici. Ciò implica che competenze esclusivamente giuridiche o IT non sono più sufficienti.

La conseguenza operativa è evidente: la FRIA richiede un approccio multidisciplinare. Non basta il coinvolgimento del DPO o del team legale. Servono competenze di data science, risk management, etica tecnologica e, in alcuni casi, anche conoscenze sociologiche. Questo aspetto rappresenta una delle principali sfide per le organizzazioni, soprattutto per quelle che tendono a trattare la compliance come un’attività isolata anziché come parte integrante della governance.

Un altro punto critico riguarda il contesto d’uso. La FRIA non valuta l’intelligenza artificiale in astratto, ma il modo in cui viene utilizzata. Lo stesso sistema può presentare livelli di rischio completamente diversi a seconda del settore, delle finalità e delle categorie di soggetti coinvolti. Questo rende impossibile adottare modelli standardizzati o checklist rigide. Ogni valutazione deve essere costruita su misura, partendo da un’analisi concreta dei processi decisionali.

Qui emerge un secondo errore frequente: l’idea che sia possibile “industrializzare” la FRIA con modelli precompilati. Sebbene strumenti e template possano essere utili, il rischio è quello di trasformare un processo sostanziale in un esercizio formale, svuotandolo di efficacia. Una FRIA ben fatta richiede tempo, confronto interno e, in molti casi, anche il coinvolgimento degli stakeholder.

Infine, è importante sottolineare che la FRIA non è solo uno strumento di mitigazione del rischio, ma anche un’opportunità strategica. Le organizzazioni che riescono a integrare seriamente questo processo possono migliorare la qualità delle decisioni, ridurre il rischio reputazionale e aumentare la fiducia degli utenti. Al contrario, chi la affronta come un obbligo burocratico rischia di esporsi a criticità ben più ampie di una semplice non conformità normativa.

In sintesi, la vera sfida non è “fare la FRIA”, ma comprendere cosa significa davvero utilizzarla. Non è un documento, ma un processo. Non è un vincolo, ma un meccanismo di responsabilizzazione. E soprattutto, non riguarda solo la tecnologia, ma il modo in cui le organizzazioni scelgono di esercitare il proprio potere decisionale nell’era dell’intelligenza artificiale.

Vedi Infografica